パラメータ数が多くなるとメモリとGPUの能力への要求レベルが高くなりますが、32GBのM4 MacBook Proでどの程度まで動くのか試してみた

モデルは以下の通り、

% ollama ls

NAME ID SIZE MODIFIED

gemma2:27b 53261bc9c192 15 GB About an hour ago

mixtral:latest a3b6bef0f836 26 GB 2 hours ago

elyza:jp8b e81c07bbe038 4.9 GB 4 weeks ago

llama3.2:latest a80c4f17acd5 2.0 GB 4 weeks ago

mixtralだと、アクティビティモニターが黄色(ほぼ赤に近い)レベルまでメモリを食い尽くすから使えない、使って初めてスワップも発生

ハードリソース的にほぼ限界かと思えるのが、gemma2:27bでこの時のメモリモニターを見ると、メモリは最大近くまで使う感じ

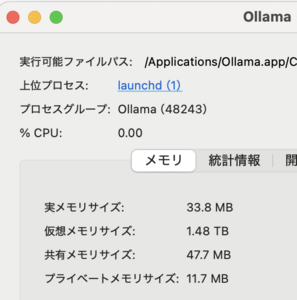

ちなみにOllamaの情報見ると、仮想メモリサイズが1.48TBとか、この数値はSSDのサイズ1Tも超えているんですが、

ということで、モデルのパラメータ数で30b程度が32GBメモリのMacで動かせる限界のようです

ちなみにこのサイズのパラメータで初めて日本で一番高い山の回答が正しく返ってくるから、それ以下のパラメータでは実用性はそれほどないのかもしれない

admin