一月末からほぼ100日プロジェクトでしたが、ようやく全ての機能を統合できました

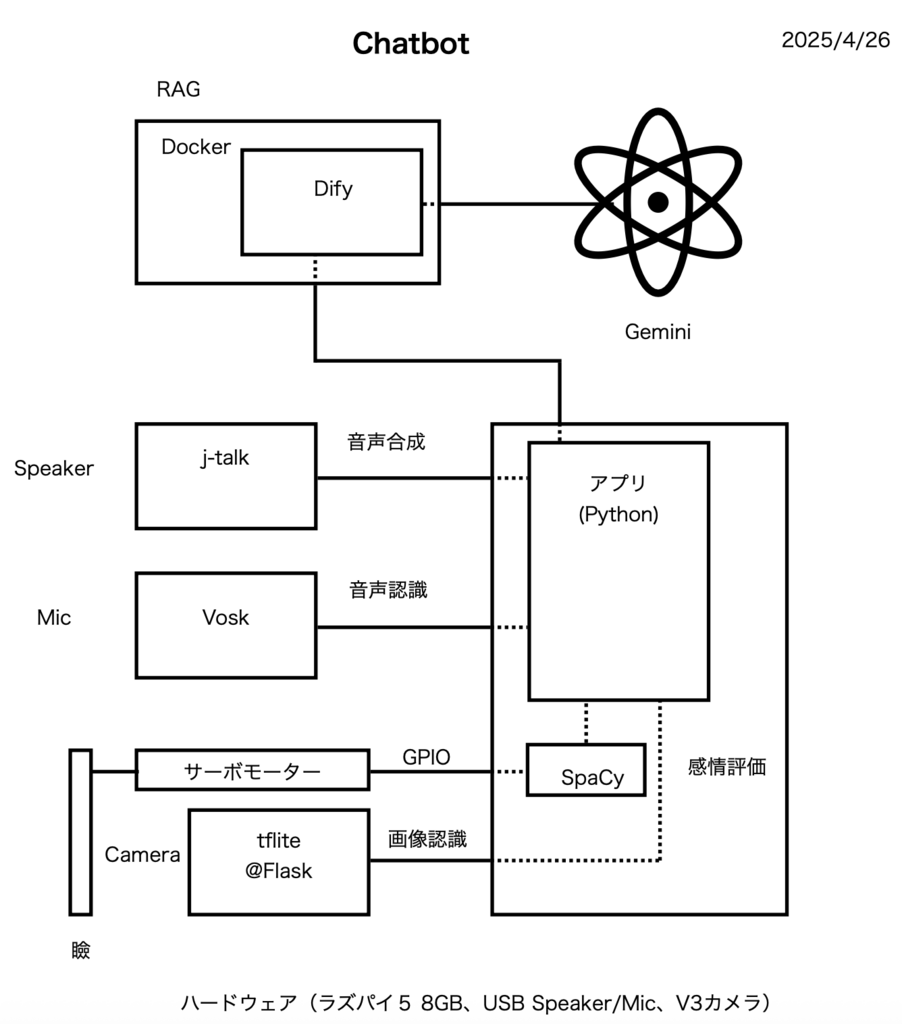

具体的には、画像認識で人の認識を行う、音声認識と音声出力でLLMと会話する、カメラは眼球に仕込んで瞼の動きは状態(起動表示、レスポンス内容の喜怒哀楽)を返す手段とする、というところですが、LLMをラズパイ5のローカル動作は割と早めに断念してそこはクラウドを使用(API KEYはローカルのDifyへのアクセス用でGeminiのKEYは明には見えないようになっています)

現状のコード等は以下のリンクに、

https://github.com/chateight/rasp5_bot

まだいくつかbuggyなところは残ってますが、追加機能の現状のアイディアとしては顔画像から表情を読み取ることですね

現状の機能としては、

① アプリが立ち上がったら音声メッセージを出す

② カメラが人(person)検出したらこれも音声メッセージを出して③に移行する

③ Dify経由でLLMとチャットモードで問い合わせのやり取りを行う

admin