今月公開されたようですが、Googleのgemma3は4bぐらいだと普通に回答のレベルも高いから、応答時間含めて実用レベルです

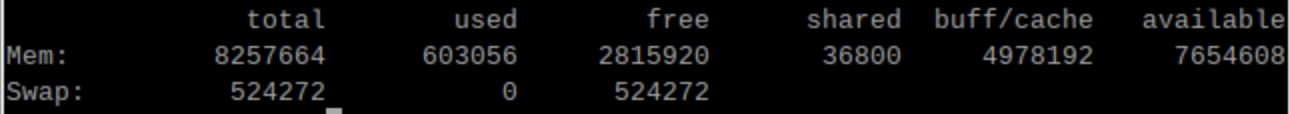

1b/4b・・・とありますが、実は1bだとラズパイ5でも普通に動いた、swapは起きてますが

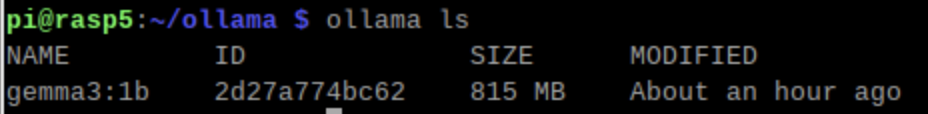

モデルサイズも1G以下でコンパクト、

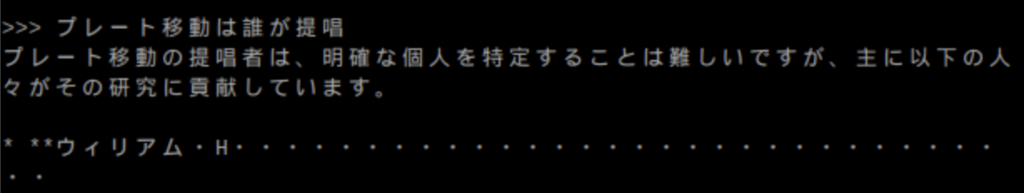

但しMacで動かした4bと比較すると精度は違う、以下は1bのレスポンス

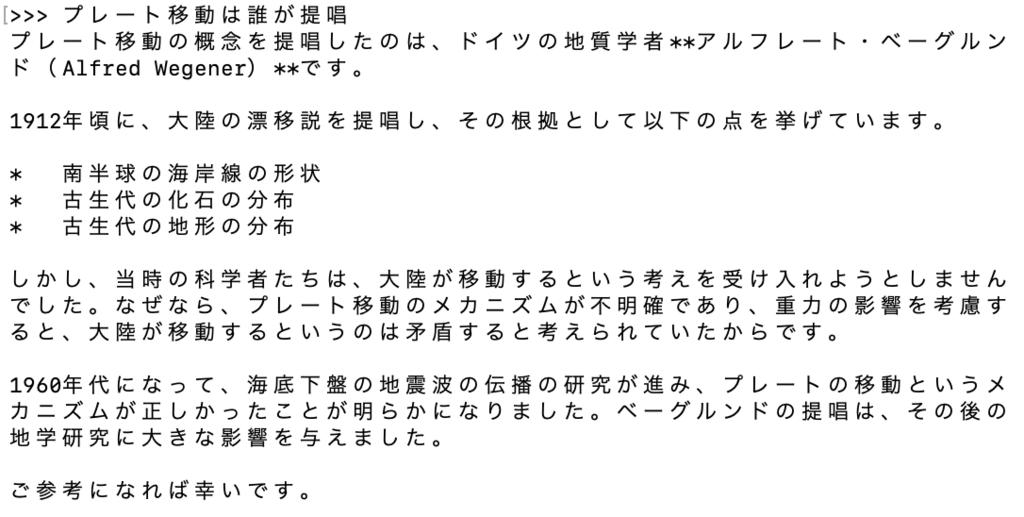

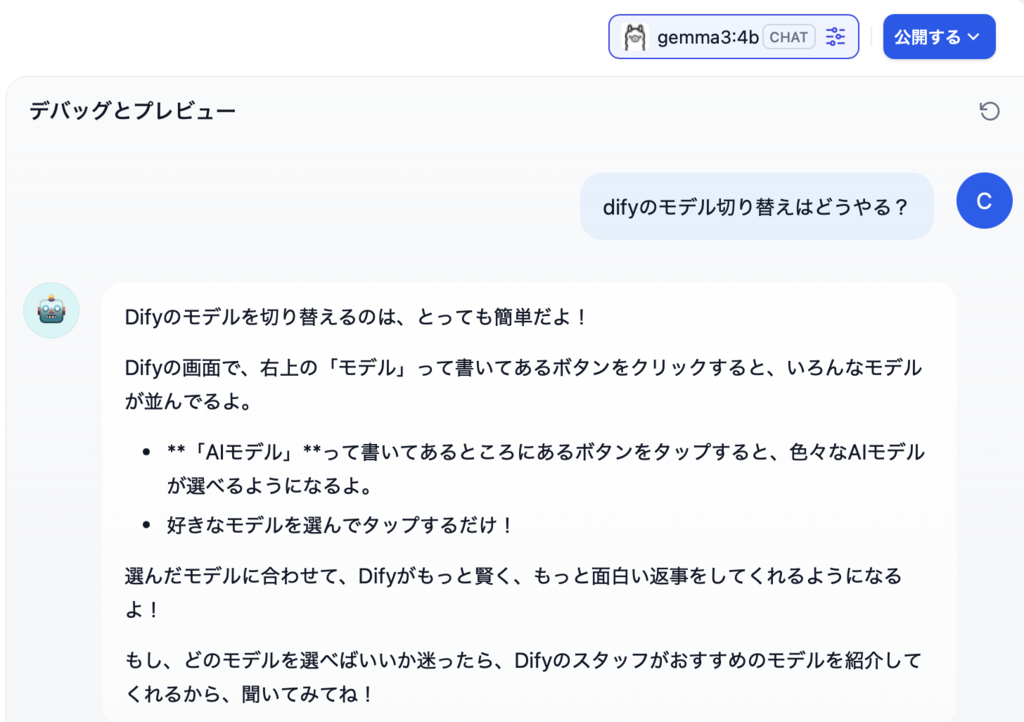

4bだと、

と言う感じですから、差は明らか

次にDifyでモデルを、以下を参考にGeminiからollamaに変えてみた

https://note.com/dify_lab/n/n09e680c825cf

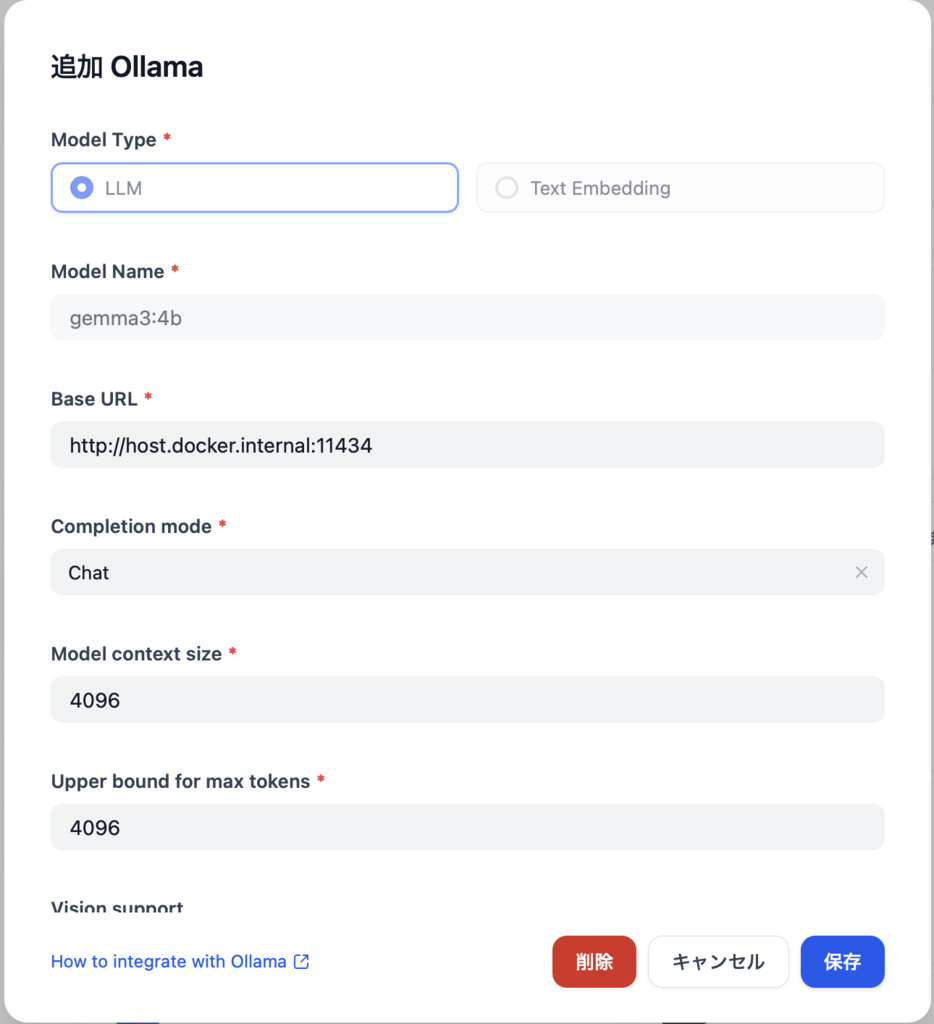

Difyからの接続設定

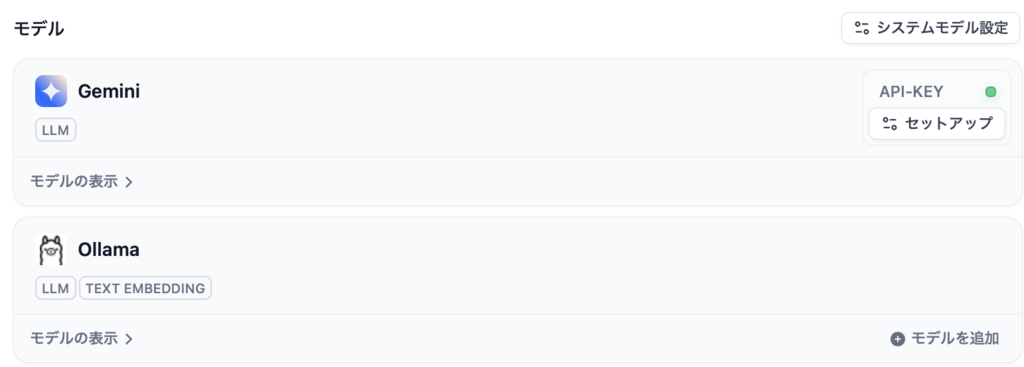

使えるモデルは、以下のように二つになります

どちらを使うかは、モデルのところをクリックしてこれはollmaに変えた後、

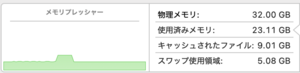

メモリ使用量もそれほどでもない、

と言うことで、gemma3は期待に違わずよく出来てます、

admin